Es probable (aunque no automático) que la amígdala de su cerebro, tan diminuta como el tamaño de una almendra, empiece a activarse. Allí se fijan las emociones. Es factible (aunque no axiomático) que usted no lo razone demasiado, se deje llevar por su sesgo de confirmación (esa tendencia a interpretar las cosas para confirmar la creencia previa) y, si le sirve, le dé al botón de “reenviar”. En horas el video habrá sido más visto que muchas de las piezas propagandísticas para las cuales los partidos destinan dinerales en los medios tradicionales.

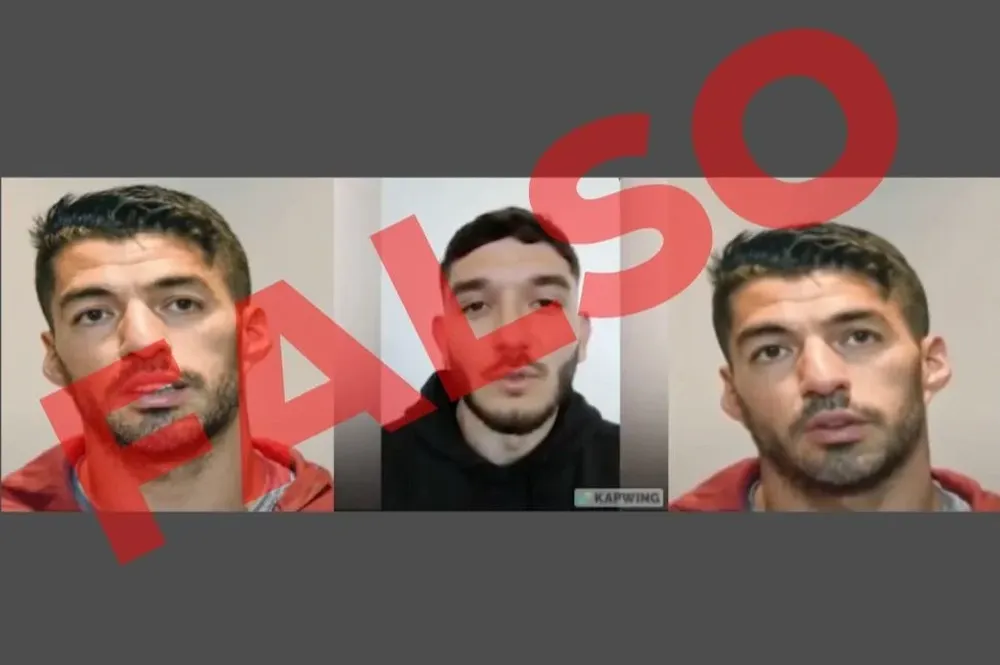

La fabricación de imágenes –fijas o en movimiento– y audios hiperrealistas es, gracias a los avances de la inteligencia artificial, simple y barata. No importa si es para hacer el bien o el mal. El Observador y Digital Sense –compañía uruguaya líder en procesamiento de imágenes y aprendizaje automático– crearon un video en que un Luis Suárez que no es Luis Suárez se mueve al compás de los gestos que le va instruyendo uno de los ingenieros. En el video a continuación se suprimió la voz —también del falso goleador del Gremio, pero que se escucha como tal— para evitar el uso malicioso, pero el personaje bien podría estar anunciando su llegada a Peñarol por más inverosímil que suene.

“Ya no se trata del estatus de verdad puesto en disputa por la emocionalidad y la fe de las personas –‘yo creo que’–, sino que los deepfakes apelan a los sentidos, a la famosa sentencia que dicta que aquello que podemos ver es, sin dudas, cierto: ‘lo he visto con mis propios ojos’", explica el politólogo Brian Majlin, coordinador de Periodismo en la Universidad ORT Uruguay y exconsultor de Alfabetización Mediática en la plataforma argentina de verificación Chequeado.

La democracia no ha estado exenta de las “campañas sucias”, de la llamada por teléfono a deshora fingiendo ser una encuesta del candidato adversario (como ocurrió en el pasado ciclo electoral uruguayo), o frases fuera de contexto. Pero, ¿qué pasará en la próxima campaña ante una proliferación de video falsos hiperrealistas que, según una investigación de la Universidad Northwestern, se duplican cada menos de un semestre?

Majlin no lo sabe. Los comicios primarios en Argentina, por citar el caso más próximo en la geografía, evidencian que los deepfake fueron más usados en cuentas parodias que en verdaderas campañas orquestadas para hacer el mal. Un ejemplo es el video bromeando con que Sergio Massa fue el fundador de la patria. Pero, reconoce el politólogo, la velocidad de avance de las herramientas y, sobre todo, la masificación que le permite a casi cualquiera crear su propio engaño “llevan la indeterminación de los real al paroxismo”.

Según el publicista Claudio Invernizzi, cerebro de la campaña electoral de la fórmula liderada por el frenteamplista Daniel Martínez, la “revolución científico-tecnológica” hizo realidad “el sueño de los malvados”. ¿Por qué? Las herramientas permiten llegar a una audiencia más masiva incluso adulterando contenidos que se comunican. Un escenario perfecto para, dice el experto, “estimular la pérdida de valores y debilitar la resistencia de la verdad”.

En la última campaña electoral en Uruguay, circuló una página adulterada de un libro con la biografía del actual presidente Luis Lacalle Pou. Su asesor de comunicación, el publicista Roberto Lafluf, lo recuerda bien porque tuvo que medir su impacto. Y ahora, cuatro años después y desde un despacho en el piso 11 de la Torre Ejecutiva que acredita su respuesta, sentencia: “el contenido malicioso no logró su objetivo y, por lo general, se vuelve como en un efecto boomerang contra quienes lo promovieron”.

Aun así, Lafluf admite que “preocupa bastante” y que “es peligroso” el avance que está teniendo la inteligencia artificial al servicio del contenido falsificado, por lo que no descarta que en la próxima campaña local “haya gente, militantes, que de manera aislada y por fuera de las estructuras de los partidos políticos generen contenidos maliciosos y eso repercuta en el desconcierto de mucha otra gente”. Eso sí: el publicista insiste con que “la madurez del sistema de partidos uruguayo da suficientes garantías para que ese material de engaño no penetre en las campañas oficiales”.

Tiempos modernos

Si Facebook fue la sorpresa en las dos contiendas estadounidenses en que ganó Barack Obama, y si el escándalo de Cambridge Analytica marcó la victoria de Donald Trump, “las próximas elecciones serán las de la inteligencia artificial y mucho más disruptivas”, dijo Tom Newhouse, de la empresa republicana Convergence Media que utiliza la inteligencia artificial.

“La inteligencia artificial es la tecnología que permite a las computadoras aprender y tomar decisiones como los humanos. Utiliza algoritmos y datos para imitar la inteligencia, resolviendo problemas, reconociendo patrones y automatizando tareas”. Así define a la inteligencia artificial el ChatGPT, que usa inteligencia artificial, cuando se le pide una explicación sencilla que quepa en el tamaño de un tuit.

Cuatro de cada diez empresas en América Latina incorporaron la inteligencia artificial para alguna de las tareas que desempeña su compañía, según el último índice que elabora IBM. El nivel de adopción de estas herramientas casi se triplicó en el último lustro y, a partir de ahora, su crecimiento “podría ser exponencial”.

En el terreno electoral, los partidos políticos en el mundo desarrollado ya están explotando la tecnología para la minería de datos, para conocer mejor el interés y el comportamiento de sus potenciales votantes, y no necesariamente con fines destructivos.

Es la política, a su vez, la que tiene la capacidad de construir (valga la redundancia) políticas. El Senado estadounidense está en plena discusión de proyectos de ley que buscan regular la inteligencia artificial. Mientras Google ya aprobó un cambio en su política para que, a partir de noviembre, las imágenes que se carguen en la web y hayan sido adulteradas con inteligencia artificial tengan que tener una advertencia, una especie de octógonos de los alimentos con exceso de “mentira”.

¿La verdad?

Octubre de 1938. En la radio anuncian como una noticia “urgente” un aterrizaje extraterreste. Los oyentes de Nueva Jersey y Nueva York se van enterando de la invasión acorde van sintonizando la emisora. Muchos se perdieron la advertencia inicial en la que Orson Welles explicaba que se trataba de una ficción. Con el correr de los minutos crecen las escenas de pánicos y la alarma social.

La adaptación radiofónica de la novela La guerra de los mundos fue un punto bisagra en la discusión de los límites de la verdad. Puso en tela de juicio cómo las advertencias de que “cualquier similitud con la realidad es mera coincidencia de la ficción” no siempre tienen éxito. Y que la humanidad va aprendiendo a lidiar con sus propias invenciones.

“Si logramos generar consciencia de que existen herramientas de engaño profundo, podemos volver a entrar en una dinámica cultural donde tengamos un sano escepticismo respecto de las imágenes y audios que nos llegan… sobre todo a través de WhatsApp que es el medio más virulento y nocivo para la circulación de estas falsificaciones”, explica el filósofo Javier Mazza, director de Humanidades y Comunicación en la Universidad Católica del Uruguay.

La propia tecnología, dice Mazza, se va encargando “de quitarle verosimilitud a las imágenes que se reproducen” y, como ejemplo, cita que en Instagram ya existe una contrato entrelineado “en que el usuario sabe que la persona o el paisaje no se ve así y está alterada por un filtro”.

Marina Gardella, una uruguaya que está cursando su doctorado en Matemática Aplicada en Francia con una tesis focalizada en la detección de imágenes falsas, explica que “la propia tecnología permite hacer de contralor” de los atropellos de la tecnología. Ya hoy existen herramientas de inteligencia artificial que detectan las trazas (imperceptibles al ojo humano) que dan cuenta de que una fotografía tiene altas chances de haber sido modificada.

Ese chequeo, complementa el politólogo Majlin, suele avanzar más lento que la viralización o circulación de la desinformación, pero el solo hecho de ser verificable es “prueba suficiente sobre los efectos positivos del chequeo y la alfabetización mediática informacional”.

Poco a poco, considera la matemática Gardella, el proceso de chequeo y alfabetización irá haciéndole entender a la humanidad aquello que ella le repite a su madre: "no todo lo que llega por WhatsApp, u otra red, es verdadero". Reconoce que la instantaneidad con que se comparte la información y la superabundancia de la misma narcotizan al usuario, por lo que "se requiere un nuevo contrato de interpretación, de lectura de las imágenes y audios".

En ese sentido, dice Invernizzi, los periodistas profesionales pasan a ser actores clave en esa función de discernir qué es verdad. El periodista Gabriel Pereyra viene insistiendo: la función del periodismo ya no consiste en pasar información del punto A al punto B, sino "saber qué no publicar".

Impedir la marcha de la tecnología, como intentó el ludismo en el comienzo de la revolución industrial, “es un sinsentido; por el contrario lo más sensato es aprovechar la misma tecnología para contrarrestar sus fallas”, dice el catedrático de Ingeniería Eléctrica de la Universidad de la República, Pablo Musé, uno de los expertos uruguayos en inteligencia artificial y procesamiento de imágenes. Los deepfake, agrega, serán “cada día más sofisticados y más difíciles de chequear”, porque en definitiva el entrenamiento computacional requiere de mejores bases de datos y menores sesgos, por lo cual “la dimensión ética tiene que ser clave en el nuevo relacionamiento humano”.

Cuando comenzó la identificación facial, recuerda Musé, las máquinas confundían a algunos afrodescendientes con monos. O hablaban de los ingenieros (en masculino) y las maestras (en femenino). ¿El motivo? Reproducían los sesgos y discriminación de las propias bases humanas con las que eran entrenadas. “Acorde pasa el tiempo, el trabajo forense de detección de imágenes se complejiza y a la vez, es probable, se populariza”.

Su tutoreada Gardella es prueba de esa popularización. Su trabajo consiste en que el proceso de verificación no quede solo en ámbitos académicos y técnicos, sino que empiece a extenderse en apps de celulares, en extensiones de los exploradores de internet o hasta en huellas que den la trazabilidad de las imágenes.

Existe un proyecto, por ejemplo, en que las nuevas cámaras que se fabriquen (para celulares, réflex, mirrorless o cualquier otra) ya tengan incorporado un sello de verificación, de manera tal que ante cualquier alteración se sepa que no es la original. "La lógica detrás es que cada imagen deje su huella para que sea más fácil de rastrear", dice la matemática uruguaya.

Mientras ocurre "esta curva de aprendizaje", concluye el publicista Lafluf, "la duda es una buena aliada del pensamiento crítico". Tal vez el René Descartes del siglo XXI hubiese cambiado su famoso “pienso, luego existo”, por “dudo, luego existo”.