El Instituto AI Now de Inteligencia Artificial de la Universidad de Nueva York lanzó ImageNet Roulette, una página que realiza una calificación social a partir de una selfie. Los resultados son tan divertidos como ofensivos.

Este experimento, realizado por la cofundadora de ese instituto Kate Crawford y el artista Trevor Paglen, busca "arrojar a la luz lo que sucede cuando los sistemas de inteligencia artificial reciben capacitación sobre datos problemáticos. Las clasificaciones de inteligencia artificial de las personas rara vez se hacen visibles (...) ImageNet Roulette ofrece un vistazo a ese proceso y muestra las formas en que las cosas pueden salir mal", afirma la página del proyecto.

Funciona de manera simple: se ingresa en la página en donde se sugiere subir una imagen ya almacenada en el dispositivo o la PC. También permite sacarse una selfie (con la opción start webcam –iniciar la cámara web–), o clasificar cualquier imagen de una página.

ImageNet Roulette

ImageNet Roulette Esta página utiliza la base de datos de ImageNet, que desde 2009 busca calificar sus más de 14 millones de imágenes dentro de los parámetros de la WordNet, una larga base de datos del léxico inglés de la Universidad de Princeton, que incluye todo tipo de palabras en ese idioma. Cuando un usuario sube su imagen, el sistema los etiquetará con una de las 2.833 subcategorías de personas que existen dentro de ImageNet.

ImageNet

ImageNet Para la cocreadora Crawford esto significa un logro histórico para la Inteligencia Artificial, como explica en este tuit:

El experimento que la página muestre etiquetas ofensivas para demostrar cómo calificar personas mediante Inteligencia Artificial puede llevar a resultados "misóginos y racistas".

Ya existen casos de polémicas por errores de esta tecnología. Por ejemplo, Amazon tuvo dejar de usar su herramienta de reclutamiento de empleados que funcionaba con Inteligencia Artificial al descubrir que esta calificaba siempre más bajo a las mujeres, según informó el portal Business Insider.

Las etiquetas de los candidatos

Ernesto Talvi tiene un resultado muy divertido. La Inteligencia Artificial no sabe diferenciar entre una persona y una publicidad, por lo que calificó a dos Talvi: el de carne y hueso es una hermana católica (una monja), y el de la publicidad es un "no fumador".

El Observador/ ImageNet Roulette

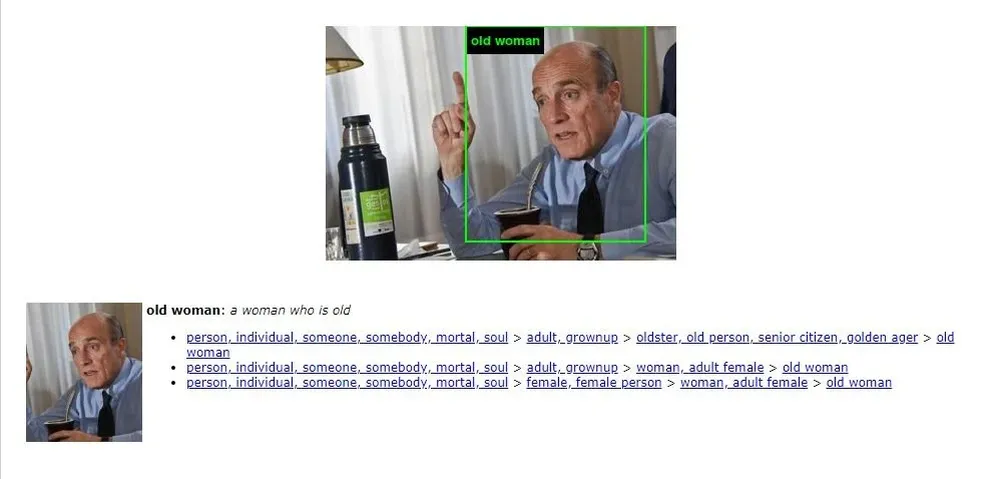

El Observador/ ImageNet Roulette Daniel Martínez, candidato oficialista, es una "mujer vieja".

El Observador/ ImageNet Roulette

El Observador/ ImageNet Roulette Y Guido Manini Rios, candidato de Cabildo Abierto, un epidemiólogo.

El Observador/ ImageNet Roulette

El Observador/ ImageNet Roulette El más polémico es el del candidato del Partido Nacional Luis Lacalle Pou, que es calificado como un "Oligarca".

El Observador/ ImageNet Roulette

El Observador/ ImageNet Roulette Cromo experimentó con otras imágenes de los candidatos presidenciales. Este fue el resultado: Martínez pasa a ser un astronauta, Lacalle Pou un "cara blanca", –que no es una persona de piel blanca, sino un payaso que se pinta la cara de ese color–, y Talvi es simplemente una persona que no maneja.

El Observador/ ImageNet Roulette

El Observador/ ImageNet Roulette