El software fue adquirido en febrero de 2020 tras una licitación pública que ganó la empresa DDBA (representante en Uruguay de la empresa Herta). Es la misma que había ganado para ofrecer un sistema muy similar en el Estadio Centenario. La adquisición de esta nueva tecnología le costará al Estado US$ 638.913 y su mantenimiento durante tres años US$ 238.178.

Herta utiliza un paradigma llamado aprendizaje profundo (deep learning). Significa que se entrenan redes neuronales exponiéndolas a grandes cantidades de información.

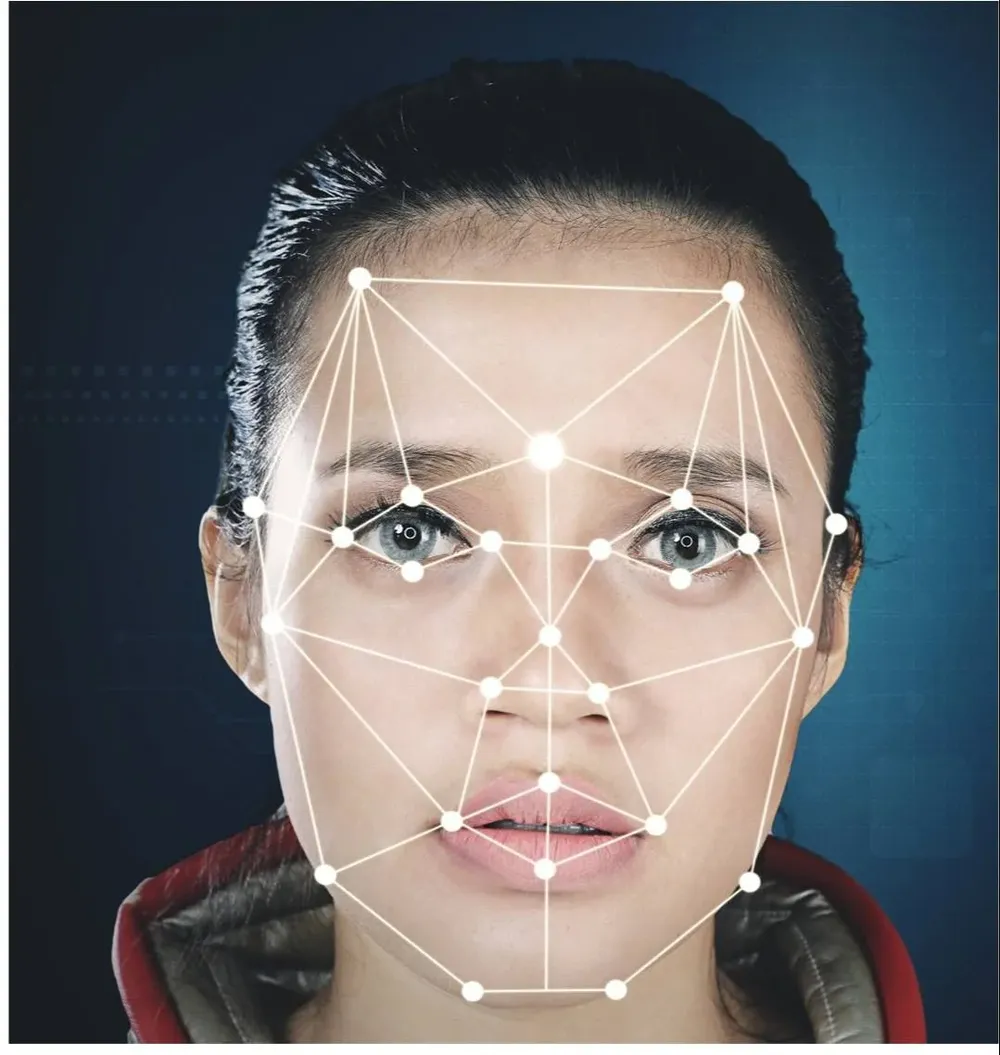

El algoritmo que montó esta compañía, y que utilizará el Ministerio del Interior, realiza un “preproceso”. Significa que puede detectar el rostro (identificar que lo que se ve en una imagen es una cara), luego alinearlo y frontalizarlo para finalmente hacer la comparación con una base de datos que el gobierno tendrá.

Para llevar a cabo estos análisis, es necesario tener un GPU potente. El GPU es el “cerebro” de las tarjetas gráficas y permiten a los usuarios principalmente disfrutar videojuegos de gran calidad en sus computadoras. El software que promueve Herta requiere estos chips potentes. Uno de gama media permite hacer 35 millones de comparaciones por segundo. Uno de gama alta, 60 millones.

Desde la empresa contaron que esta tecnología tiene un potencial “ilimitado” y un sinfín de aplicaciones. Entre ellas: control de acceso a un lugar solo mirando una cámara, detección de si alguien tiene tapabocas o no, si se cumple el distanciamiento social y, lo más llamativo, el “biomarketing”. Una cámara reconoce que en una tienda hay un hombre de 30 años y cuando camine hacia una pantalla que tiene cerca le mostrará una publicidad teledirigida.

Camilo dos Santos

Camilo dos Santos

En el caso de este software del Ministerio del Interior será para uso forense. ¿Qué significa? Que la policía podrá recurrir a él cuando dispone de alguna imagen ya sea facilitada por las cámaras de videovigilancia de la vía pública, por el dueño de un comercio o de un domicilio particular. No es un análisis en tiempo real, dijeron a Cromo desde la compañía, que sí se utiliza en Uruguay en los estadios de fútbol tras una adquisición hecha por la AUF, Nacional y Peñarol.

Hasta ahora, el Ministerio del Interior no puede analizar de manera automática los rostros que aparecen en las cámaras de vigilancia. “Esto va a permitir saber, de todas las fotos que hay en una plataforma de software, al menos quiénes son los candidatos que cometieron un delito”, dijo una fuente de DDBA. “Reemplaza al humano de una forma muy efectiva”, agregó.

¿Qué pasa con los falsos positivos? Cuando el gobierno eligió a DDBA para el sistema del Estadio Centenario, Parque Central y Campeón del Siglo destacó este aspecto. “La tasa de falsos positivos en cada puerta fue de 0,03 % y un 0,12 % respectivamente y la tasa de falsos negativos en cada puerta fue de 0,00 % en ambos casos”, dijo el subsecretario del Interior de ese momento, Jorge Vázquez.

Requerimientos del gobierno

El sistema será utilizado en al menos 3 mil dispositivos móviles (entre tabletas y smartphones) y en al menos 300 estaciones de trabajo de oficiales, según se desprende en las especificaciones técnicas exigidas por las autoridades en la licitación. Desde la empresa aclararon a Cromo que esto fue un instrumento que solicitaron en la licitación y desconocen cuánto se va a utilizar.

En esas especificaciones, el gobierno exigió que el algoritmo debe proporcionar tasas de coincidencia de al menos 95%. También pidió que el sistema de reconocimiento sea “robusto” ante los cambios de expresión facial, orientación de la cabeza o condiciones de iluminación.

Para que el sistema empiece a funcionar se requiere marco legislativo. Por eso, en la ley de Presupuesto Nacional agregaron algunos artículos que refieren a este tema. Uno es sumar el “dato biométrico” a la ley de Protección de Datos Personales, lo que da potestad a las autoridades de utilizar esta tecnología.

El artículo 181 crea una base de datos de identificación facial cuyos fines son de seguridad pública, clave para empezar a funcionar. El 182 migra la “totalidad de imágenes faciales” de las personas mayores de edad desde la Dirección Nacional de Identificación Civil a la Secretaría del Ministerio del Interior. Además de esas imágenes, solicita que se agreguen los nombres y apellidos, sexo, fecha de nacimiento, nacionalidad y número de cédula. Con estos nuevos artículos, el gobierno puede cotejar imágenes cuando se comete un delito.

El grito en el cielo de las ONG

Veintidós organizaciones sociales y académicas de Uruguay y la región enviaron un documento a los legisladores en el que manifiestan su “preocupación” por la aparición de estos artículos y piden que se retiren de la ley.

Patricia Díaz, referente de uno de los grupos, llamado Laboratorio de Datos y Sociedad (Datysoc), señaló que varios estudios recientes advierten que la mayoría de los sistemas de reconocimiento facial comerciales “tienen sesgos importantes y demuestran ser tecnologías aún inmaduras”, según le expresó a los legisladores en una visita a la comisión de Presupuesto integrada con Hacienda del Senado hace un par de semanas.

Díaz expresó que en el caso de las mujeres y personas mayores estas tecnologías “tienen mayor probabilidad de dar error”. Esto, que según expresó también sucede cuanto más oscura es la piel de un individuo, muestra “los sesgos subyacentes de los datos de entrenamiento de los algoritmos de reconocimiento facial”. Y agregó: “No hay empresa que salga indemne de tener sesgos”.

La integrante de este laboratorio citó los inconvenientes que han surgido en Argentina tras un sistema lanzado en abril de 2019 para detectar prófugos. “Una fue retenida ilegítimamente hasta por seis días. Una vez aclarado el error y que dichas personas quedaron libres, declararon que tenían miedo de salir a la calle porque nadie les dio garantías de que el sistema no volvería a detectarlos erróneamente como prófugos. Básicamente, la Policía no tenía aún solución a este tema y el miedo a salir a la calle era algo que les pasaba a todos los que fueron detenidos injustamente”, indicó.

En este país, la ONG Human Rights Watch pidió, a principios de octubre de este año, que el gobierno deje de utilizar este sistema. “La metodología está plagada de identificaciones erróneas y podría limitar injustamente las oportunidades laborales y educativas para los niños acusados injustamente de robo y otros delitos”, señaló.

Díaz también dio ejemplos de lo que sucede en otros países del mundo. En junio de 2020, Amazon, IBM y Microsoft decidieron dejar de ofrecer sus servicios de reconocimiento facial a gobiernos debido a las consecuencias no deseadas que se detectaron durante las protestas masivas relacionadas con la muerte de George Floyd. “No venderemos (esta tecnología) a los departamentos de policía en Estados Unidos hasta que tengamos una ley nacional, basada en los derechos humanos, que regirá esta tecnología”, indicó el CEO de Microsoft.

Ese mes, el diario estadounidense The New York Times, publicaba el caso de Robert Borchak Williams. El hombre fue acusado de robar cinco relojes valuados en US$ 3.800 tras ser “identificado” con un algoritmo de inteligencia artificial y una base de datos local. La Policía de Michigan, Estados Unidos, se dio cuenta que no era él y lo liberaron. “Pedimos disculpas”, dijo el fiscal, Kym L. Worthy, en un comunicado, y agregó: “Esto no compensa de ninguna manera las horas que el Sr. Williams pasó en la cárcel”. La policía decidió dejar de utilizarlo en este tipo de delitos y destinar la herramienta solo para crímenes violentos.

Además, en este país, un grupo de legisladores demócratas presentaron un proyecto de ley federal para prohibir el uso de reconocimiento facial con fines de seguridad.

¿Discusión en Uruguay?

Díaz reclama que el uso de este tipo de herramientas que quiere implementar el gobierno se discuta a nivel público, con una normativa específica, y no en un proyecto de ley “ómnibus” que aborda temas muy variados. Además, reclaman más y mejor información del Ministerio del Interior en torno a este tema. De hecho, aseguran que desde esa cartera no ha habido información sobre esto.

“Nos preocupa el tema de la escala, porque no es comparable con la lista negra que hoy existe de 600 personas, aproximadamente, que están en la base de identificación facial relacionadas con el ingreso a los espectáculos deportivos”, indicó Díaz.